OpenClaw核心架构与工作原理

一文彻底看懂 AI Agent 是如何运行的

最近 AI 圈里有一个非常热门的概念:

AI Agent(智能体)

相比传统 AI 只负责“回答问题”,Agent 更像一个 可以执行任务的 AI 助手。

而在众多 Agent 项目中,OpenClaw 是目前非常受关注的一个开源框架。

很多人第一次接触 OpenClaw 都会有这些疑问:

- OpenClaw 是 AI 吗?

- 为什么它可以自动执行任务?

- 它的内部架构到底是什么?

本文将从 系统架构、Agent运行机制、记忆系统 三个角度,带你完整理解 OpenClaw 的核心工作原理。

一、OpenClaw 是什么?

简单来说:

OpenClaw 是一个 AI Agent 运行平台。

它的核心作用是:

让 AI 不只是“聊天”,而是可以 调用工具并执行任务。

传统 AI 的模式是:

用户提问 → AI回答而 OpenClaw 的模式是:

用户指令

↓

AI理解任务

↓

调用工具

↓

执行操作

↓

返回结果因此很多开发者把 OpenClaw 称为:

AI 自动化操作系统(Agent OS)

借助 OpenClaw,AI 可以完成很多自动化工作,例如:

- 自动回复消息

- 自动浏览网页

- 自动查询数据

- 自动操作软件

- 自动执行脚本

这也是 AI 从 “聊天工具”向“自动执行系统”转变的重要一步。

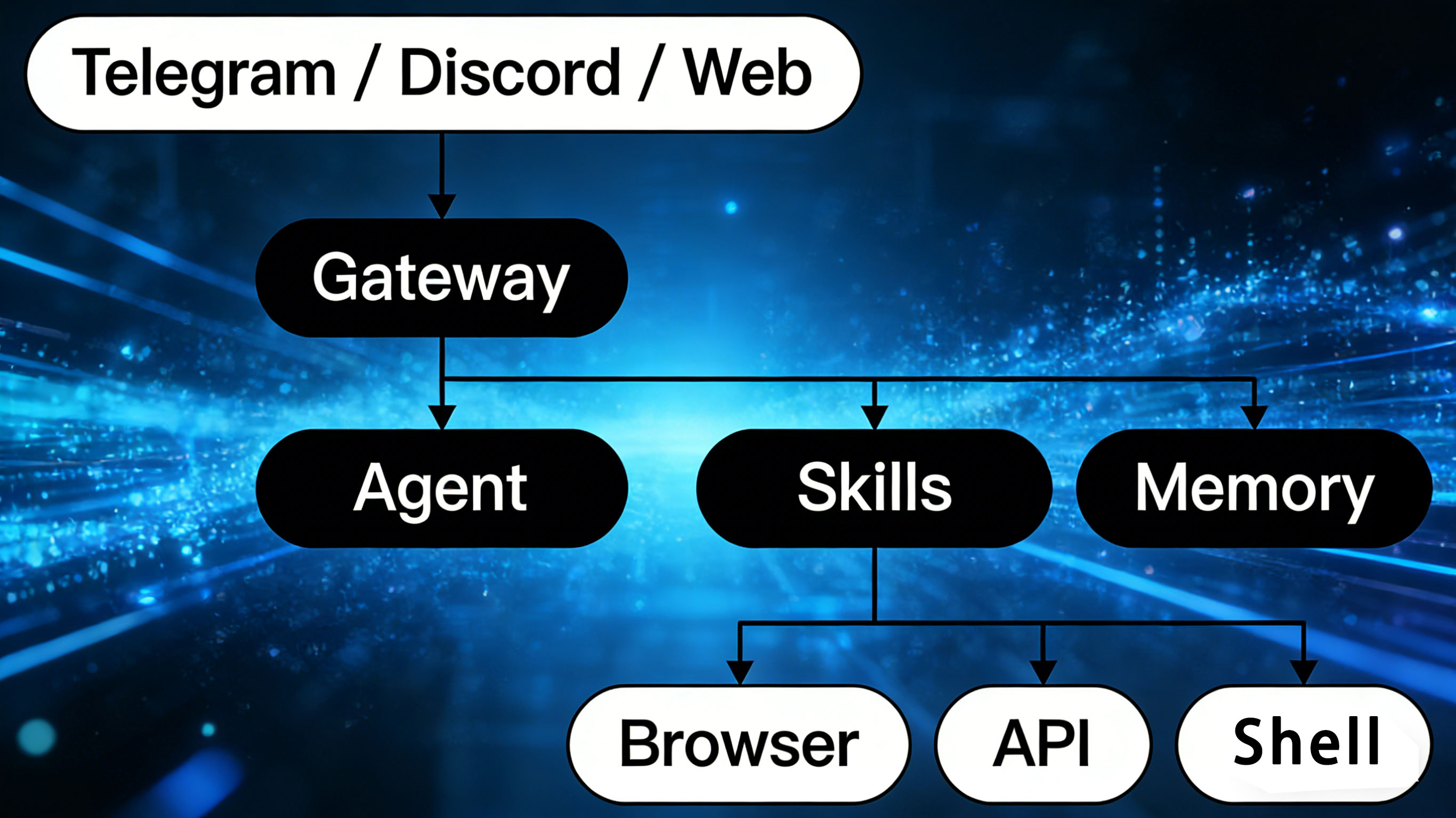

二、OpenClaw整体架构

从整体上看,OpenClaw 的系统架构可以分为五个层级:

Channel(用户入口)

↓

Gateway(系统网关)

↓

Agent(智能体)

↓

Skills / Tools(工具能力)

↓

External System(外部系统)OpenClaw整体架构图

下面我进行逐层解释。

三、Channel:用户入口

Channel 是用户与 OpenClaw 交互的入口。

常见渠道包括:

- Telegram

- Discord

- Web界面

- Webhook接口

- 定时任务

例如:

用户在 Telegram 中发送消息:

帮我查一下今天比特币价格消息就会被发送到 OpenClaw 系统。

四、Gateway:系统控制中心

Gateway 是 OpenClaw 的 核心控制模块,就像我们的门,所有进来的数据都经过这个关卡。

所有消息都会先进入 Gateway,然后再转发给 Agent。

Gateway 的主要职责包括:

- 接收用户消息

- 管理会话

- 调度 Agent

- 调用技能

- 返回执行结果

可以理解为:

OpenClaw 的操作系统内核。

技术实现通常基于:

- Node.js

- WebSocket

- HTTP API

五、Agent:真正的 AI 大脑

Agent 是 OpenClaw 的核心组件。

它负责:

- 用户请求--理解用户指令

- 任务理解--分析需求核心意图

- 任务拆解--分解为可执行子任务

- 调用工具--匹配并调用AI工具

- 整理结果--输出结构化最终结果

一个典型的 Agent 执行流程如下:

与普通 AI 不同的是:

Agent 可以 主动调用工具执行任务。

例如:

用户:帮我查BTC价格AI:1. 判断需要查询数据2. 调用 web-search 工具3. 获取数据4. 整理回答六、Skills / Tools:AI 的能力系统

OpenClaw 的能力来源于 Skills(技能)。

Skill 可以理解为:

AI 的插件系统。

例如:

常见技能包括:

- 网页搜索

- 文件操作

- API调用

- 浏览器自动化

- Shell命令执行

每个 Skill 通常包含:

SKILL.mdscripts/config/安装 Skill 后,Agent 就可以直接调用。

OpenClaw 还提供 ClawHub 技能市场,类似于:

- Chrome 插件商店

- VSCode 插件市场

用户可以:

搜索技能

安装技能

更新技能

发布技能七、Agent 的 Workspace 机制

在 OpenClaw 中,每个 Agent 都拥有一个 独立工作空间(Workspace)。

Workspace 是一个文件夹,用来定义 Agent 的人格、权限和记忆。

典型结构如下:

workspace/

├── AGENTS.md

├── SOUL.md

├── TOOLS.md

├── IDENTITY.md

├── USER.md

├── MEMORY.md

└── HEARTBEAT.md这些文件共同构成了 Agent 的完整人格系统。

1 AGENTS.md:职责定义

AGENTS.md 定义 Agent 的职责范围,例如:

你是一个技术专家负责回答AI相关问题可以理解为:

Agent 的岗位说明书。

2 SOUL.md:灵魂提示词

SOUL.md 是 Agent 的 核心 Prompt。

它决定:

- Agent 的性格

- 回答风格

- 思考方式

例如:

你是一名严谨的软件工程师回答问题必须给出完整示例3 TOOLS.md:工具权限

TOOLS.md 用来控制:

允许使用哪些工具禁止使用哪些工具例如:

allow: web-search

deny: shell这样可以避免 AI 执行危险操作。

4 MEMORY.md:长期记忆

MEMORY.md 是 Agent 的长期记忆文件。

例如:

用户是一名开发者用户喜欢PythonAgent 会根据这些信息优化回答。

八、Agent 的启动机制

OpenClaw 的 Agent 并不是 长期运行的进程。

它的运行方式非常特别:

每一次对话都会创建一个新的 Agent 实例。

完整流程如下:

这种设计的好处是:

- 配置修改立即生效

- 会话互不干扰

九、OpenClaw 的记忆系统

OpenClaw 的记忆机制是整个系统中 非常关键的一部分。

它把记忆分成 三层结构:

Session记录

短期记忆

长期记忆具体结构如下:

.openclaw/

agents/

└── sessions/

└── session.jsonl

workspace/

└── memory/

└── 2026-03-12.md

workspace/

└── MEMORY.md1 Session:会话记录

每一次对话都会保存到:

sessions/xxxx.jsonl记录内容包括:

- 用户消息

- AI回复

- 工具调用

- 执行结果

2 每日记忆

系统还会按天记录重要信息:

memory/YYYY-MM-DD.md例如:

用户正在学习OpenClaw

用户对Agent架构感兴趣3 长期记忆

最终,AI 会把重要信息整理到:

MEMORY.md这就是 Agent 的长期记忆。

十、如何避免上下文爆炸?

如果对话太长,LLM 的 Context 很容易被撑爆。

OpenClaw 为此设计了三种优化机制。

1 压缩(Compaction)

旧对话会被自动总结为摘要。

例如:

旧对话 → summary这样可以减少 Token 消耗。

2 修剪(Pruning)

一些工具执行结果可能非常大,例如:

- HTML页面

- API数据

- 日志文件

系统会把旧结果替换为:

[Old tool result cleared]从而减少上下文大小。

3 历史限制

系统还可以限制:

最多发送多少条历史消息进一步控制上下文长度。

十一、为什么建议使用多个 Agent?

在实际使用中,很多开发者发现:

单个 Agent 很容易出现“记忆污染”。

例如:

你创建了一个 Flutter教学Agent。

但中途讨论过 C++问题。

之后 AI 在回答 Flutter 问题时可能会:

给出C++代码示例因此实践中通常会:

为不同任务创建不同 Agent。

例如:

| Agent | 职责 |

|---|---|

| 开发助手 | 编程问题 |

| 数据分析师 | 数据分析 |

| AI秘书 | 日常事务 |

这样可以显著提高 AI 的稳定性。

十二、OpenClaw的意义

OpenClaw 的核心架构可以总结为:

Channel → Gateway → Agent → Skills → Tools其核心特点包括:

- Gateway 中心架构

- 插件化技能系统

- 文件化记忆系统

- 多 Agent 协作

- 自动化执行能力

OpenClaw 的出现标志着 AI 正在从:

聊天工具

逐渐发展为:

自动化执行系统。

未来 AI 的形态很可能是:

想法

↓

AI执行

↓

结果而 OpenClaw 正是这一趋势的重要代表。

结语

随着 AI Agent 技术的发展,我们正在进入一个新的时代:

AI 不再只是回答问题,而是可以真正帮我们完成工作。

OpenClaw 只是一个开始。

未来,我们每个人都可能拥有属于自己的 AI Agent 团队。